در این بخش سورس کد آموزش شبکه عصبی با الگوریتم گرگ خاکستری GWO در متلب قرار داده شده است. شبکههای عصبی Artificial neural network از تعداد زیادی عنصر پردازشی فوقالعاده بههمپیوسته به نام نرون تشکیلشده که برای حل یک مسئله با یکدیگر بهصورت هماهنگ عمل میکند. شبکه عصبی یک الگوریتم نیست بلکه یک چارچوب برای بسیاری از الگوریتم های مختلف از جمله یادگیری ماشین برای همکاری و پردازش اطلاعات پیچیده است.

برای افزایش دقت یادگیری در شبکه های عصبی می توان این شبکه را با الگوریتم های فرا ابتکاری یا تکاملی ترکیب کرد یعنی برای وزن دهی لایه های مختلف موجود که ارتباط آن ها با یال هایی است می توان مقادیر وزن ها ها یا یال ها را با الگوریتم های فرا ابتکاری تعیین کرد. یکی از این الگوریتم ها، الگوریتم گرگ خاکستری GWO می باشد. که در این بخش سورس کد آماده آن در متلب برای یک دیتاست ساده (دیتاست سرطان سینه) نوشته شده است.

برنامهنویس: تیم برنامه نویسی پی استور

متشکل از اساتید و فارغ التحصیلان رشته های فنی - مهندسی

تیم برنامه نویسی پی استور یکی از اولین گروه های تشکیل شده در مجموعه آموزشی پی استور می باشد. این تیم از اساتید مجرب و فارغ التحصیلان رشته های فنی و مهندسی تشکیل شده که در زمینه های مختلف برنامه نویسی و تهیه سورس کد فعال هستند.

شبکه عصبی مصنوعی

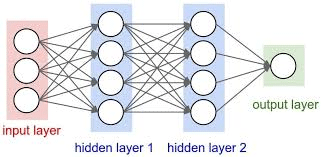

شبکههای عصبی ANN از تعداد زیادی عنصر پردازشی فوقالعاده بههمپیوسته به نام نرون تشکیلشده که برای حل یک مسئله با یکدیگر بهصورت هماهنگ عمل میکند. دستهبندی شبکههای عصبی شبکهای از لایههاست، معمولاً لایهای که اطلاعات ورودی به آنها داده میشود تحت عنوان لایهی ورودی و لایهای که دادههای خروجی از آن دریافت میشود تحت عنوان لایهی خروجی نامیده میشود و به لایههای دیگر بین این دولایه (در صورت وجود) لایههای پنهان گفته میشود.

جهت حرکتها سیگنالها همواره از سمت لایهی ورودی بهسوی لایهی خروجی است برای دستهبندی یک نمونه تستی، وزن کلمهها برای واحدهای ورودی تعیین میشود و فعال کردن این واحدها از طریق لایههای مختلف روبهجلو در شبکه انجام میشود و مقدار واحد خروجی بهعنوان یک نتیجه در تصمیمگیری دستهها تعیین میشود.

شبکه های عصبی مصنوعی، سیستم های محاسباتی هستند که توسط شبکههای عصبی زیستی الهام گرفته شده اند که مغز حیوانات را تشکیل می دهند. منظور از يادگيري در شبکههای عصبی، تنظيم وزن ها و باياس هاي شبكه مي باشد. بر اين اساس الگوريتم های متفاوتی بيان شده، كه معمول ترين آنها یادگيري هب، دلتا، يادگيری رقابتی و … می باشد.

الگوریتم گرگ خاکستری

الگوریتم گرگ خاکستری Grey Wolf Optimizer یا به اختصار GWO توسط سید علی میرجلیلی (Seyedali Mirjalili) در سال 2014 در مقاله Grey Wolf Optimizer در ژورنال Advances in Engineering Software پایگاه علمی Elsevier ارائه شده است. این الگوریتم فراکتشافی یا الگوریتم بهینه سازی بر اساس رفتار و شیوه شکار گرگ های خاکستری است. این الگوریتم مبتنی بر جمعیت بوده، فرآیند ساده ای دارد و به سادگی قابلیت تعمیم به مسائل با ابعاد بزرگ را دارد.

الگوریتم گرگ خاکستری GWO از ساختار سلسله مراتبی hieratical و رفتار اجتماعی گرگ های خاکستری در هنگام شکار کردن الهام گرفته است. این الگوریتم مبتنی بر جمعیت بوده، فرآیند ساده ای دارد و به سادگی قابلیت تعمیم به مسائل با ابعاد بزرگ را دارد. گرگ های خاکستری به عنوان شکارچیان راس یا apex در نظر گرفته می شوند، که در بالای هرم زنجیره غذایی هستند.

گرگهای خاکستری ترجیح می دهند در یک گروه (دسته) زندگی کنند، هر گروه به طور متوسط 5-12 عضو دارد. همه اعضای این گروه دارای سلسله مراتب تسلط اجتماعی بسیار دقیق هستند و وظایف خاصی دارند. در هر گله از گرگ ها برای شکار کردن ۴ درجه وجود دارد.

- گرگ های رهبر گروه alpha نامیده می شوند که می توانند مذکر یا مونث باشند. این گرگ ها بر گله تسلط دارند

- گرگ های beta: کمک به گرگ های alpha در فرایند تصمیم گیری بوده و همچنین مستعد انتخاب شدن به جای آن ها هستند.

- گرگ های delta: پایین تر از گرگ های beta و شامل گرگ های پیر، شکارچی ها و گرگ های مراقبت کننده از نوزادان

- گرگ های omega: پایین ترین مرتبه در هرم سلسله مراتب که کمترین حق را نسبت به بقیه اعضای گروه دارند. بعد از همه غذا می خورند و در فرایند تصمیم گیری مشارکتی ندارند.

برای مشاهده توضیحات بیشتر در این زمینه مقاله ای تحت عنوان الگوریتم گرگ خاکستری GWO در این سایت قرار داده شده است که می توانید مطالعه کنید.

آموزش شبکه عصبی با الگوریتم گرگ خاکستری GWO در متلب

همانطور که قبلاً هم اشاره شد برای تعیین وزن یال ها و بایاس ها در شبکه های عصبی می توان از الگوریتم های فرا ابتکاری استفاده کرد. از این رو در این سورس کد تعیین وزن بایاس ها و یال ها با استفاده از الگوریتم گرگ خاکستری انجام پذیرفته است. برای تعیین میزان عملکرد برنامه ذکر شده از دیتاست سرطان سینه استفاده شده است که در ادامه این دیتاست تشریح شده است.

دیتاست مورد استفاده در این سورس کد

به عنوان یک نمونه دیتاست مورداستفاده مجموعه داده بیماران سرطان سینه موجود در مخزن دادهی یادگیری ماشین دانشگاه ارواین، ایالت کالیفرنیا آمریکا (University of California at Irvine) است مثال زده می شود.

در این دیتاست ویژگی ها شامل ریسک فاکتورهای ضخامت انبوه، یکنواختی اندازه سلول، یکنواختی شکل سلول، چسبندگی لبهها، حجم سلول بافت اپیتلیال، هستههای عریان، کروماتین بلاند، هسته عادی و تقسیم هسته سلول به دو قسمت میباشد که در ایالت ویسکانسین ایالاتمتحده جمعآوریشده است. جدول زیر نشاندهنده این مجموعه از داده است.

| ردیف | نام ویژگی | محدوه |

|---|---|---|

| 1 | code number | id number |

| 2 | Clump Thickness | 1 – 10 |

| 3 | Uniformity of Cell Size | 1 – 10 |

| 4 | Uniformity of Cell Shape | 1 – 10 |

| 5 | Marginal Adhesion | 1 – 10 |

| 6 | Single Epithelial Cell Size | 1 – 10 |

| 7 | Bare Nuclei | 1 – 10 |

| 8 | Bland Chromatin | 1 – 10 |

| 9 | Normal Nucleoli | 1 – 10 |

| 10 | Mitoses | 1 – 10 |

| 11 | Class | 2 for benign, 4 for malignant |

قسمت هایی از سورس کد در متلب

%% Start of Program clc clear close all warning off; N=40; max_it=100; Vmax=0.5; Vmin=-0.5; %% Input Output Data load IOdata Data = IOdata; X = Data(:,1:end-1); Y = Data(:,end); XN = X; YN = Y; %% Normalization % MinX = min(X); MaxX = max(max(abs(X))); MinY = min(Y); MaxY = max(max(Y)); % % XN=XN/MaxX; YN=floor(YN/MaxY); %% Test and Train Data NumOfInputs = size(X,2); NumOfOutputs = size(Y,2); NumOfData = size(X,1); NumOfHiddens=2*NumOfInputs+1; TrPercent = 70; DataNum = size(X,1); TrNum = round(TrPercent * DataNum/100); R = randperm(DataNum); TrInx = R(1:TrNum); TsInx = R(TrNum+1:end); Xtr = XN(TrInx,:); Ytr = YN(TrInx,:); Xts = XN(TsInx,:); Yts = YN(TsInx,:); %% Network Training [NetworkP ,BestCostP, BestChartP] = TrainUsingGWO_Fcn(Xtr,Ytr,N,max_it,NumOfInputs,NumOfHiddens ,NumOfOutputs, Vmax, Vmin);

تصاویر خروجی

ویدئوی معرفی

درباره آموزش شبکه عصبی با الگوریتم گرگ

سورس کد آموزش شبکه عصبی با الگوریتم گرگ خاکستری GWO در متلب عنوان محصولی است که در این پست به آن پرداخته شده است. محصول در نرم افزار متلب نوشته شده و برای تعیین مقادیر وزنی یال ها و بایاس ها شبکه عصبی با الگوریتم GWO می باشد. این سورس کد بصورت کامل توسط گروه پشتیبانی پی استور تست و اجرا شده است. محصول دارای نشان تضمین کیفیت پی استور می باشد. برای دانلود محصول آن را خریداری کنید.

سورس کدهای آماده برای آموزش شبکه عصبی با الگوریتمهای دیگر

مباحث مربوط به الگوریتم گرگ خاکستری GWO

آموزش های مربوط به شبکه های عصبی مصنوعی

آموزش شبکه عصبی با الگوریتم گرگ خاکستری GWO در متلب

| تاریخ انتشار: | 21 آذر 1399 |

|---|---|

| تاریخ بروزرسانی: | 15 فروردین 1400 |

| حجم فایل: | 6 کیلوبایت |

| فرمت فایل | m. |

| هماهنگی با: | متلب 2017 و بالاتر |

| سفارش تدریس: | توضیحات تکمیلی |

تاکنون 633 نفر این محصول را تهیه کرده اند و 2 نظر برای آن ثبت شده است.

نظرات و دیدگاه ها

قوانین ثبت دیدگاه

- لطفاً دیدگاه های خود را فارسی تایپ کنید.

- دیدگاه های نامرتبط به مطلب تایید نخواهد شد.

- از درج دیدگاه های تکراری پرهیز نمایید.

- سوالات تخصصی خودتان را از طریق تیکت پشتیبانی مطرح کنید.

آموزش شبکه عصبی با الگوریتم گرگ خاکستری GWO در متلب

هزینه سفارش: 139,000 تومان

| تاریخ انتشار: | 21 آذر 1399 |

|---|---|

| تاریخ بروزرسانی: | 15 فروردین 1400 |

| حجم فایل: | 6 کیلوبایت |

| فرمت فایل | m. |

| هماهنگی با: | متلب 2017 و بالاتر |

| سفارش تدریس: | توضیحات تکمیلی |

2 بازخورد (مشاهده نظرات)

هزینه سفارش: 139,000 تومان

اکبر

خیلی خوب بود. همون چیزی بود که لازم داشتم.

مدیریت و پشتیبانی

نظرات خود را با ما در میان بگذارید.